El 30 de noviembre de 2022 parecía un día de otoño cualquiera para la comunidad educativa y científica que llevaba muchos años colaborando, trabajando en equipo y compartiendo en abierto, para tratar de acercar la inteligencia artificial (IA) a la escuela con rigor y en base a unas directrices éticas. Sin embargo, desde ese día nada volvería a ser lo mismo.

Ese día se publicó ChatGPT. Y muchas personas que hasta entonces no habían publicado acerca de la IA ni un solo artículo -no ya científico, ni tan siquiera de opinión-, que no habían participado en ni una sola iniciativa para promover la IA en educación, o que jamás habían compartido ni un solo recurso sobre IA, ese día, algunas de estas personas descubrieron la IA generativa y, casi de la noche a la mañana, se autoproclamaron expertos en IA.

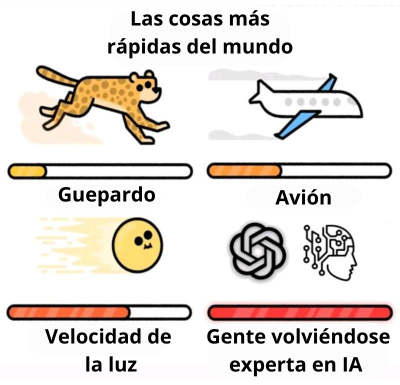

Meme sobre las cosas más rápidas en el mundo. Es una traducción del original, del que se desconoce su autor.

Es una de las consecuencias de la IA generativa. Y es que, como su nombre indica, está diseñada para que le pidas cosas usando lenguaje natural y el sistema te las genere. Así de sencillo. Por tanto, es fácil pensar que uno se ha vuelto experto en IA simplemente por saber usar a nivel usuario estos sistemas. En las versiones iniciales había que utilizar algunos trucos, con la famosa ingeniería de prompts, que se compartían por internet y tan solo había que copiar y pegar. Con las nuevas versiones ya casi ni es necesario.

Pero como la IA generativa se ha puesto tan de moda y ha inundado las noticias en medios y redes, ha habido un grupo de personas que ha visto un filón para posicionarse como expertos en IA y ponerse a vender cursos de pago, acudir a todos los saraos educativos o ponerse a promocionar productos de empresas de tecnología educativa. Gente que se limita a publicar en redes sociales demos vistosas de la última herramienta y que nunca realizan un análisis crítico del mismo, ni consideran las directrices éticas de la Comisión Europea para el uso de la IA en educación, ni tienen en cuenta nada más que el hecho de que llame la atención.

Con cada anuncio de OpenAI o de Stability AI, ahí están en redes unos minutos después, publicando una demo rápida sin la más mínima crítica o análisis, aderezada con muchos iconos, textos sensacionalistas y técnicas de influencers y coolhunters.

De hecho, muchas de las demos que publican contienen errores de bulto. Por ejemplo, comparten imágenes o vídeos de chatGPT generando una propuesta didáctica en la que chatGPT se inventa parte de la normativa, y ni siquiera se dan cuenta. Y ahí siguen las publicaciones, con miles de personas compartiéndolas.

Lamentablemente, la táctica les funciona. Algunas administraciones educativas caen en su juego y les invitan a jornadas en calidad de expertos en IA. Por supuesto, cada aparición en cualquier evento la promocionan hasta el infinito, ya que así, cuando otra administración o entidad busca a un experto en IA, es fácil que den con ellos.

Y esto podría ser simplemente triste. Pero es que está empezando a ser peligroso para docentes y estudiantes.

Por un lado, he participado en eventos en los que también estaban algunos representantes de este movimiento y he presenciado que intentan limitarse a decir cosas obvias y sin moverse de lugares comunes. Pero como realmente no conocen los fundamentos de la IA, en cuanto tienen que profundizar lo más mínimo o salirse del guion comparten información incorrecta que puede ser dañina y peligrosa para el alumnado.

Estoy convencido de que hay gente de este movimiento que no lo hace con mala intención, simplemente se ha autoconvencido de ser experto en IA. Así, cuando en alguna ocasión han publicado en redes algo problemático y se les ha comunicado, han borrado el mensaje o lo han modificado, incluso a veces agradeciendo la ayuda.

Por poner tan solo un ejemplo, una persona con miles de seguidores en redes estaba informando al profesorado de que detectar si un estudiante había usado chatGPT para escribir un texto era tan sencillo como copiar el texto a chatGPT y preguntar si lo había generado el sistema. Y cientos de docentes estaban compartiendo este truco tan maravilloso que empezarían a usar en clase ya mismo. Pensad un momento en las implicaciones que publicaciones como esta pueden tener, en el daño que pueden causar. Afortunadamente esta persona borró la publicación cuando le avisamos del error, aunque para entonces ya había acumulado mucha visibilidad.

Pero hay otros representantes de este movimiento que cuando se les hace algún comentario sobre una publicación problemática o peligrosa, ignoran el aviso o incluso contestan con tono faltón y condescendiente. Imaginamos que no les gusta que nos metamos en sus negocios, claro. Y lo más llamativo es que este grupo está formado por personas que en más de un caso son empleados públicos que hasta fechas recientes habían trabajado con rigor desde otros campos de la educación. Pero con la llegada de la fiebre del oro de la IA generativa en educación, parece que el rigor ha pasado a un segundo plano.

[…] Así que cuando vemos recomendar alegremente el uso de ChatGPT para cosas como la evaluación de las tareas del alumnado, sin ninguna otra indicación ni consideración con respecto a investigaciones que hayan medido su validez concreta en este ámbito, a sus sesgos, limitaciones e implicaciones éticas, no podemos evitar pensar que nos encontramos ante otro caso de una persona que ha sido cegada por la fiebre del oro de la IA generativa. […]